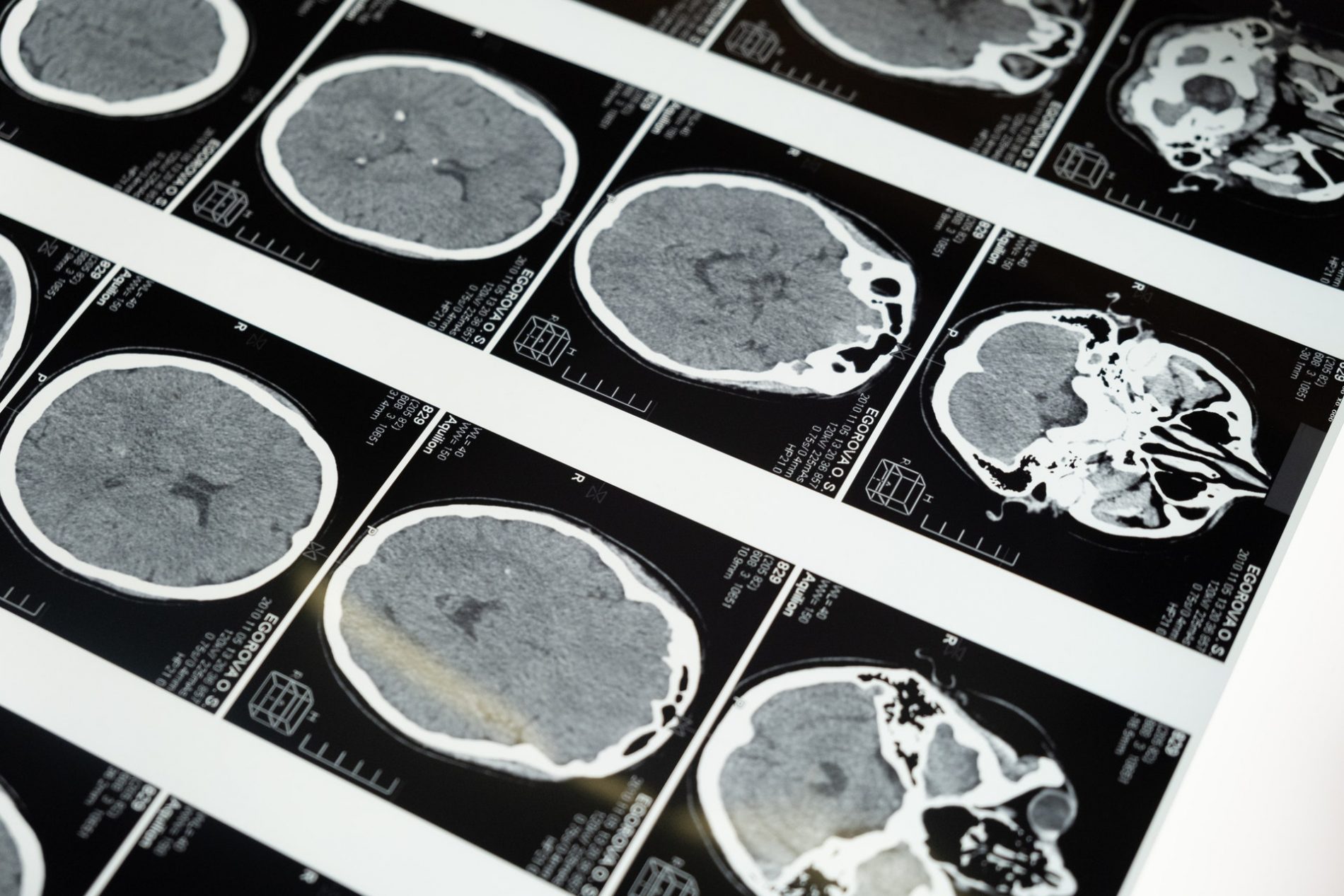

Die Krankheit ALS (Amyotrophe Lateralsklerose) ist zwar extrem selten, doch dafür umso belastender für Betroffene und ihre Angehörigen. Dabei handelt es sich um eine neurodegenerative Erkrankung, die das Nervensystem angreift und schließlich zu einer vollständigen Lähmung führt – keine Bewegungen sind mehr möglich. Ein prominentes Beispiel ist der Physiker Stephen Hawking, der ab seinem 44. Lebensjahr nur noch mithilfe eines Computerprogramms, das aus seinen Augenbewegungen Sätze formte, kommunizieren konnte. Doch was ist, wenn selbst die Augen gelähmt sind? Eine Fallstudie aus der Schweiz, die gerade in „Nature Communications“ veröffentlicht wurde, macht Hoffnung.

Locked-In: Gefangen im eigenen Körper

Forschende am Genfer Wyss Center for Bio and Neuroengineering haben in Kollaboration mit der Universität Tübingen ein sogenanntes Brain-Computer-Interface (BCI) entwickelt, mit der Kommunikation für einen vollständig gelähmten ALS-Patienten wieder möglich wurde. „Diese Studie beantwortet die seit langem gestellte Frage, ob Menschen mit komplettem Locked-in-Syndrom (CLIS) – bei denen die gesamte willkürliche Muskelkontrolle, einschließlich der Augen- und Mundbewegungen, verloren gegangen ist – auch die Fähigkeit ihres Gehirns verlieren, Befehle für die Kommunikation zu generieren“, so Jonas Zimmermann, PhD, Senior Neurowissenschaftler am Wyss Center in Genf. „Erfolgreiche Kommunikation wurde bereits mit BCIs bei Menschen mit Lähmungen nachgewiesen. Unseres Wissens ist dies jedoch die erste Studie, in der die Kommunikation mit einer Person gelungen ist, die sich nicht mehr willentlich bewegen kann und für die das BCI nun das einzige Kommunikationsmittel ist.“

Kommunizieren über Gehirnsignale

Der 37-jährige Patient, der zuhause bei seiner Familie lebt, leidet an einer schnell voranschreitenden Form von ALS. Im Laufe der Studie, die zwei Jahre dauerte, lernte er, Gehirnaktivität zu erzeugen, indem er verschiedene Bewegungen ausprobierte. Diese Gehirnsignale werden von den implantierten Mikroelektroden aufgefangen und von einem Machine Learning Algorithmus in Echtzeit entschlüsselt. Der Algorithmus ordnet den Signalen die Bedeutung ‘Ja’ oder ‘Nein’ zu. Das Programm liest dann die Buchstaben des Alphabets laut vor und mithilfe von auditivem Neurofeedback kann der Teilnehmer ‘Ja’ oder ‘Nein’ wählen, um den Buchstaben zu bestätigen oder abzulehnen, und schließlich ganze Wörter und Sätze bilden.

„Diese Studie hat auch gezeigt, dass das System unter Einbeziehung der Familie oder des Pflegepersonals prinzipiell auch zu Hause eingesetzt werden kann. Dies ist ein wichtiger Schritt für Menschen mit ALS, die außerhalb des Krankenhauses betreut werden“, erklärt George Kouvas, Forscher am Wyss Center. „Diese Technologie, die einem Patienten und seiner Familie in ihrer eigenen Umgebung zugute kommt, ist ein großartiges Beispiel dafür, wie technologische Fortschritte im Bereich der BCI umgesetzt werden können, um direkte Auswirkungen zu erzielen.“ Brain-Computer-Interfaces dieser Art sollen in Zukunft auch anderen Menschen mit Completely-Locked-In-Syndrom helfen.

Was meinen Sie?